CollabScore, un système de reconnaissance de partitions musicales

Au sein de l’Institut de recherche en informatique et systèmes aléatoires (IRISA – CNRS/Université de Rennes), Bertrand Coüasnon, maître de conférences à l’Institut national des sciences appliquées de Rennes, Aurélie Lemaitre, maîtresse de conférences à l’Université de Rennes 2, et leurs collègues s’intéressent à la création de systèmes hybrides d’analyse de documents. Dans le cadre du projet CollabScore financé par l’Agence nationale de la recherche (ANR), ils automatisent la reconnaissance du contenu de partitions de musique ancienne. À terme, ces travaux contribueront à mettre en valeur le patrimoine musical de la Bibliothèque nationale de France (BnF).

Le projet ANR CollabScore1 ambitionne de faire de la reconnaissance automatique du contenu de partitions, en s’appuyant notamment sur les collections de la BnF. En effet, celle-ci dispose d’un fond conséquent de partitions musicales, et souhaite en valoriser le contenu, en permettant notamment une lecture d'enregistrements sonores synchronisée avec un défilement de la partition ancienne. Cette démarche permettra en parallèle la sauvegarde de ce patrimoine culturel musical précieux grâce à sa digitalisation.

Bien qu’il existe déjà dans le commerce des systèmes de reconnaissance de musique, ou Optical Music Recognition (OMR), ces systèmes ne sont pas adaptés à la reconnaissance de partitions polyphoniques anciennes, complexes, ou denses telles qu’on peut en trouver à la BnF. Leur application sur un tel corpus nécessite une passe manuelle fastidieuse, dans laquelle il est nécessaire de vérifier les symboles produits un par un, en recherchant les erreurs. Cette vérification exhaustive est nécessaire, mais peut parfois être plus longue qu’une saisie manuelle complète de la partition.

À l’heure de l’intelligence artificielle (IA) et des réseaux de neurones profonds, il semble évident d’utiliser ces techniques pour réaliser la reconnaissance d’images de partitions. Cependant, elles nécessitent de grands corpus de données annotées pour leur entraînement et peuvent produire des résultats parfois illogiques, ou sans cohérence globale.

Pourtant, les règles d’écriture musicale sont clairement définies, et peuvent guider la reconnaissance du contenu des images. C’est pourquoi Bertrand Coüasnon, Aurélie Lemaitre et leur équipe ont proposé un système hybride de reconnaissance d’images de documents, combinant :

- Un système basé sur l’apprentissage profond (deep learning) pour la détection de symboles musicaux isolés ;

- L’expression de règles de la syntaxe musicale permettant de construire le contenu logique de la partition, en arrangeant les éléments musicaux.

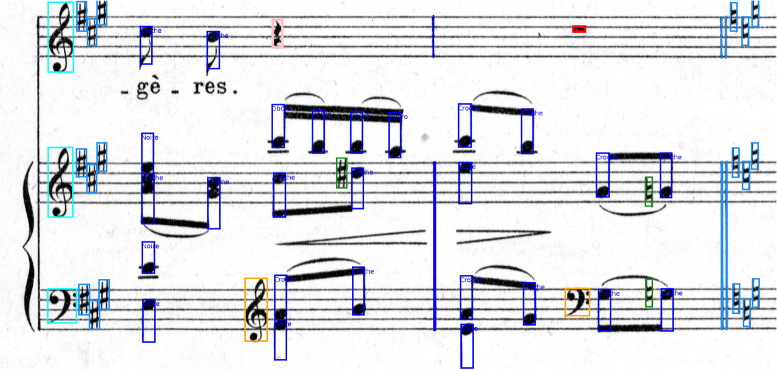

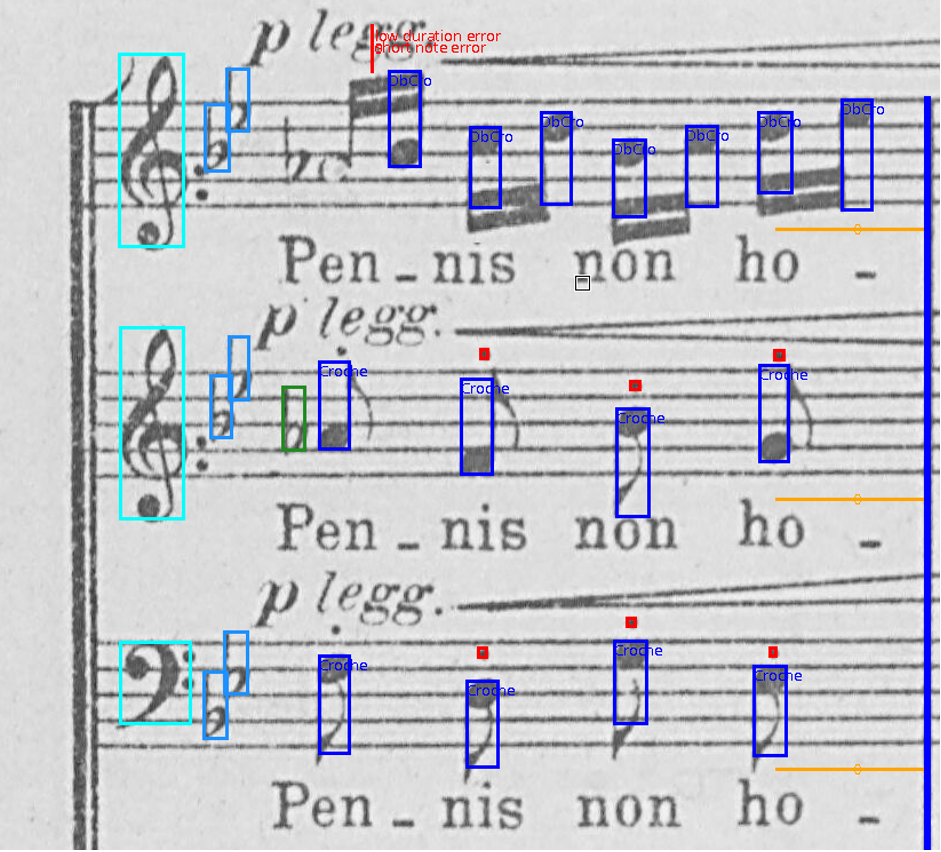

Ainsi, les symboles musicaux tels que les notes, les silences, les altérations, les clés, sont reconnus par deep learning. Leur positionnement est ensuite interprété de manière cohérente grâce à l’application de règles de la notation musicale : un système contient des portées, qui contiennent des mesures. Une mesure peut commencer par un entête (clé, chiffrage et armure), puis contient des notes et silences répartis dans une ou plusieurs voix, etc.

L’hybridation du deep learning et de cette formalisation à base de règles permet d’interpréter contextuellement les symboles, en corrigeant les éventuelles erreurs de reconnaissance du deep learning et d’avoir une réelle compréhension de la partition musicale afin de produire une sortie cohérente.

Une des forces majeures du système est que l’application des règles musicales permet de pointer précisément les incohérences de reconnaissance pour solliciter l’utilisateur.

Par exemple, dans l’image ci-dessous, le système de reconnaissance ne détecte pas la première double croche mal imprimée. Mais la connaissance transmise par la portée précédente “la mesure compte 2 temps”, ajoutée à la synchronisation des notes verticalement alignées de chacune des portées des différents instruments, vont permettre de détecter une incohérence rythmique et de produire automatiquement une sollicitation utilisateur à cet endroit précis.

La formalisation des règles permet donc de fiabiliser la reconnaissance, et en dernier recours de signaler les incohérences, l’objectif étant que l’utilisateur ait uniquement à répondre aux questions posées par le système de reconnaissance. Ceci permettra un gain de temps dans la phase de correction, puisque l’utilisateur n’aura pas à vérifier le reste de la partition si aucune autre erreur n’a été détectée par le système de reconnaissance.

Les partitions ainsi reconnues seront corrigées de manière collaborative pour produire une représentation pivot notamment nécessaire à l’alignement des partitions avec les enregistrements sonores. En collaboration avec la BnF et la Fondation Royaumont, le projet ANR CollabScore permettra la réalisation d'un démonstrateur sur l’intégralité des œuvres de Camille Saint-Saëns et d’une œuvre de Claude Debussy.

Contact

Notes

- Le projet CollabScore est piloté par le Cnam et porté par le Centre d’études et de recherche en informatique et communications (Cédric – Cnam), l’Institut de recherche en musicologie (IReMus – BnF/CNRS/Ministère de la culture/Sorbonne Université), l’IRISA, l’Université de Lille, la BnF et la Fondation Royaumont.